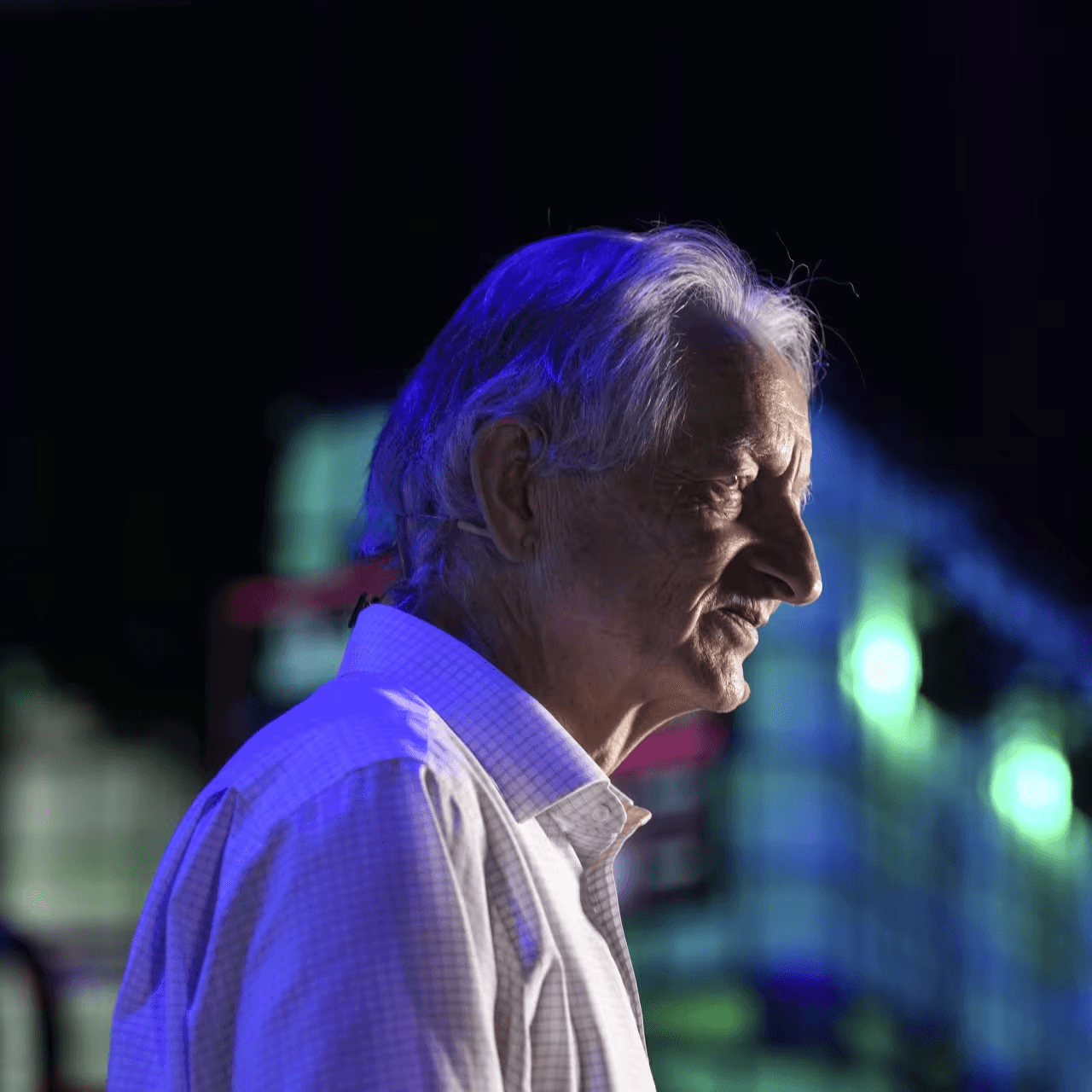

Người mới đoạt giải Nobel Geoffrey Hinton có một thông điệp về các hệ thống trí tuệ nhân tạo mà ông đã góp phần tạo ra: hãy nghiêm túc hơn về vấn đề an toàn nếu không chúng có thể gây nguy hiểm cho nhân loại.

Hinton cho biết trong một cuộc phỏng vấn hôm thứ Ba với một quan chức đoạt giải Nobel, trong đó ông bày tỏ niềm tự hào về công trình cả đời của mình với những cảnh báo về mối nguy hiểm ngày càng gia tăng mà nó gây ra: "Tôi nghĩ rằng chúng ta đang ở một thời điểm phân nhánh trong lịch sử, trong đó, trong vài năm tới, chúng ta cần tìm ra cách để đối phó với mối đe dọa đó".

Terus được cho biết thêm, Hinton, 76 tuổi, đã từ chức khỏi Google vào năm ngoái một phần để ông có thể nói nhiều hơn về khả năng các hệ thống AI có thể thoát khỏi sự kiểm soát của con người và ảnh hưởng đến các cuộc bầu cử hoặc cung cấp năng lượng cho các robot nguy hiểm. Cùng với các nhà nghiên cứu AI giàu kinh nghiệm khác, ông đã kêu gọi các công ty như OpenAI, Meta Platforms và Google thuộc sở hữu của Alphabet dành nhiều nguồn lực hơn cho sự an toàn của các hệ thống tiên tiến mà họ đang cạnh tranh với nhau để phát triển nhanh nhất có thể.

Giải Nobel của Hinton đã cung cấp một nền tảng mới cho những cảnh báo về ngày tận thế của ông, đồng thời tôn vinh vai trò quan trọng của ông trong việc thúc đẩy các công nghệ thúc đẩy chúng. Hinton lập luận rằng các hệ thống AI tiên tiến có khả năng hiểu được kết quả đầu ra của chúng, một quan điểm gây tranh cãi trong giới nghiên cứu.

Ông nói về giải thưởng này rằng: “Hy vọng điều này sẽ khiến tôi đáng tin hơn khi nói rằng những người này thực sự hiểu những gì họ đang nói”.

Quan điểm của Hinton khiến ông phải đối đầu với nhiều thành phần trong cộng đồng AI cho rằng việc tập trung vào các kịch bản ngày tận thế sẽ làm chậm tiến trình công nghệ một cách không cần thiết hoặc làm mất tập trung vào những tác hại trước mắt hơn, chẳng hạn như sự phân biệt đối xử với các nhóm thiểu số.

Melanie Mitchell, giáo sư tại Viện Santa Fe, phát biểu trong một hội thảo năm ngoái: "Tôi nghĩ ông ấy là một người thông minh, nhưng tôi nghĩ nhiều người đã thổi phồng quá mức rủi ro của những thứ này, và điều đó thực sự thuyết phục nhiều người dân rằng đây là điều chúng ta nên tập trung vào, chứ không phải những tác hại trước mắt hơn của AI".

Hinton đã đến thăm trụ sở chính của Google tại Thung lũng Silicon vào thứ ba để tham dự một buổi lễ ăn mừng không chính thức và một số giám đốc điều hành AI hàng đầu của công ty đã chúc mừng ông trên mạng xã hội.

Vào thứ Tư, những người Google nổi tiếng khác chuyên về AI cũng đã được trao giải Nobel. Demis Hassabis, giám đốc điều hành của Google DeepMind, và John M. Jumper, giám đốc phòng thí nghiệm AI, là một phần của nhóm ba nhà khoa học đã giành giải thưởng hóa học cho công trình dự đoán hình dạng của protein.

Suy nghĩ như mọi người

Hinton đang chia sẻ Giải Nobel Vật lý với John Hopfield của Đại học Princeton vì công trình của họ từ những năm 1980 về mạng lưới nơ-ron xử lý thông tin theo cách lấy cảm hứng từ bộ não con người. Công trình đó là cơ sở cho nhiều công nghệ AI đang được sử dụng ngày nay, từ các cuộc trò chuyện giống con người của ChatGPT đến khả năng nhận dạng ai là người trong mọi bức ảnh bạn chụp của Google Photos.

Yoshua Bengio, một nhà nghiên cứu AI tại Đại học Montreal, cho biết: "Những đóng góp của họ trong việc kết nối các khái niệm cơ bản trong vật lý với các khái niệm trong sinh học, không chỉ AI, những khái niệm này vẫn còn tồn tại cho đến ngày nay".

Vào năm 2012, Hinton đã làm việc với hai sinh viên tốt nghiệp của mình tại Đại học Toronto, Alex Krizhevsky và Ilya Sutskever, về một mạng lưới thần kinh có tên là AlexNet được lập trình để nhận dạng hình ảnh trong ảnh. Cho đến thời điểm đó, các thuật toán máy tính thường không thể xác định được rằng hình ảnh một con chó thực sự là một con chó chứ không phải là một con mèo hay một chiếc ô tô.

Chiến thắng vang dội của AlexNet tại cuộc thi công nghệ nhận dạng hình ảnh năm 2012 là một thời điểm quan trọng trong sự phát triển bùng nổ của AI hiện đại, vì nó chứng minh sức mạnh của mạng nơ-ron so với các phương pháp khác.

Cùng năm đó, Hinton thành lập một công ty với Krizhevsky và Sutskever, nhưng công ty này tồn tại không lâu. Google đã mua lại công ty này vào năm 2013 trong một cuộc đấu giá với các đối thủ cạnh tranh bao gồm Baidu và Microsoft, trả 44 triệu đô la về cơ bản để thuê ba người đàn ông này, theo cuốn sách “Genius Makers.” Hinton bắt đầu chia thời gian giữa Đại học Toronto và Google, nơi ông tiếp tục nghiên cứu về mạng nơ-ron.

Hinton được tôn kính rộng rãi như một người cố vấn cho thế hệ các nhà nghiên cứu AI hàng đầu hiện nay, bao gồm Sutskever, người đồng sáng lập OpenAI trước khi rời đi vào mùa xuân năm nay để thành lập một công ty có tên là Safe Superintelligence.

Hinton đã nhận được Giải thưởng Turing năm 2018, một giải thưởng về khoa học máy tính, cho công trình nghiên cứu về mạng nơ-ron cùng với Bengio và một nhà nghiên cứu AI khác, Yann LeCun. Cả ba thường được gọi là "cha đẻ của AI" hiện đại.

Cảnh báo thảm họa

Đến năm 2023, Hinton đã trở nên lo ngại về hậu quả của việc xây dựng trí tuệ nhân tạo mạnh mẽ hơn. Ông bắt đầu nói về khả năng các hệ thống AI có thể thoát khỏi sự kiểm soát của người tạo ra chúng và gây ra tác hại thảm khốc cho nhân loại. Khi làm như vậy, ông đã liên kết với một phong trào lên tiếng của những người lo ngại về những rủi ro hiện sinh của công nghệ.

Terus biết thêm trong một cuộc phỏng vấn năm ngoái Hilton đã nói rằng: “Chúng ta đang ở trong một tình huống mà hầu hết mọi người thậm chí không thể hình dung được, đó là trí thông minh kỹ thuật số này sẽ thông minh hơn chúng ta rất nhiều và nếu chúng muốn hoàn thành công việc, chúng sẽ muốn nắm quyền kiểm soát”.

Hinton tuyên bố ông sẽ rời Google vào mùa xuân năm 2023, nói rằng ông muốn có thể tự do thảo luận về những nguy cơ của AI mà không phải lo lắng về hậu quả đối với công ty. Google đã hành động "rất có trách nhiệm", ông nói trong một bài đăng trên X.

Trong những tháng tiếp theo, Hinton đã dành phần lớn thời gian để nói chuyện với các nhà hoạch định chính sách và giám đốc điều hành công nghệ, bao gồm cả Elon Musk, về rủi ro AI.

Năm ngoái, Hinton đã đồng ký vào một bài báo nói rằng các công ty thực hiện công việc AI nên phân bổ ít nhất một phần ba nguồn lực nghiên cứu và phát triển của mình để đảm bảo tính an toàn và sử dụng có đạo đức các hệ thống của họ.

Hinton cho biết trong cuộc phỏng vấn về giải Nobel: "Một điều mà chính phủ có thể làm là buộc các công ty lớn phải chi nhiều nguồn lực hơn cho nghiên cứu về an toàn, để các công ty như OpenAI không thể gác lại nghiên cứu về an toàn".

Người phát ngôn của OpenAI cho biết công ty tự hào về công tác an toàn của mình.

Cùng với Bengio và các nhà nghiên cứu khác, Hinton đã ủng hộ dự luật an toàn trí tuệ nhân tạo được Cơ quan lập pháp California thông qua vào mùa hè này, dự luật này sẽ yêu cầu các nhà phát triển hệ thống AI lớn phải thực hiện một số bước để đảm bảo chúng không thể gây ra thiệt hại thảm khốc. Thống đốc Gavin Newsom gần đây phủ quyết dự luật , điều này bị hầu hết các công ty công nghệ lớn phản đối, bao gồm cả Google.

Hoạt động tích cực hơn của Hinton đã khiến ông đối đầu với các nhà nghiên cứu đáng kính khác, những người tin rằng cảnh báo của ông là viển vông vì AI còn lâu mới có khả năng gây ra tác hại nghiêm trọng.

LeCun đã viết trong phản hồi cho Hinton on X vào năm ngoái rằng: "Việc chúng hoàn toàn không hiểu biết về thế giới vật chất và thiếu khả năng lập kế hoạch khiến chúng kém thông minh hơn loài mèo rất nhiều, chưa nói đến trí thông minh của con người".